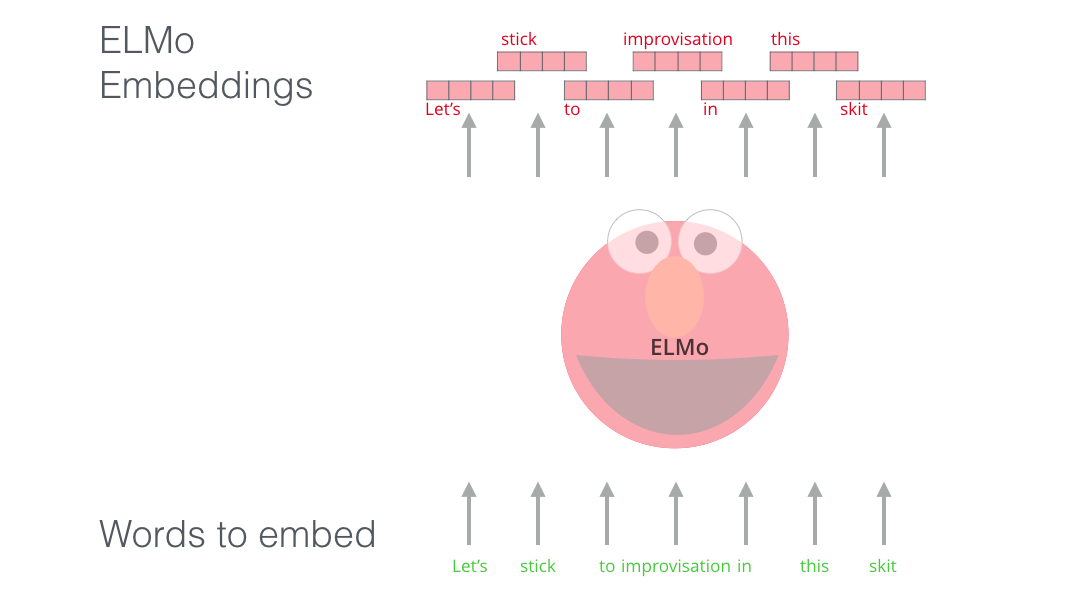

Improving a Sentiment Analyzer using ELMo — Word Embeddings on Steroids – Real-World Natural Language Processing

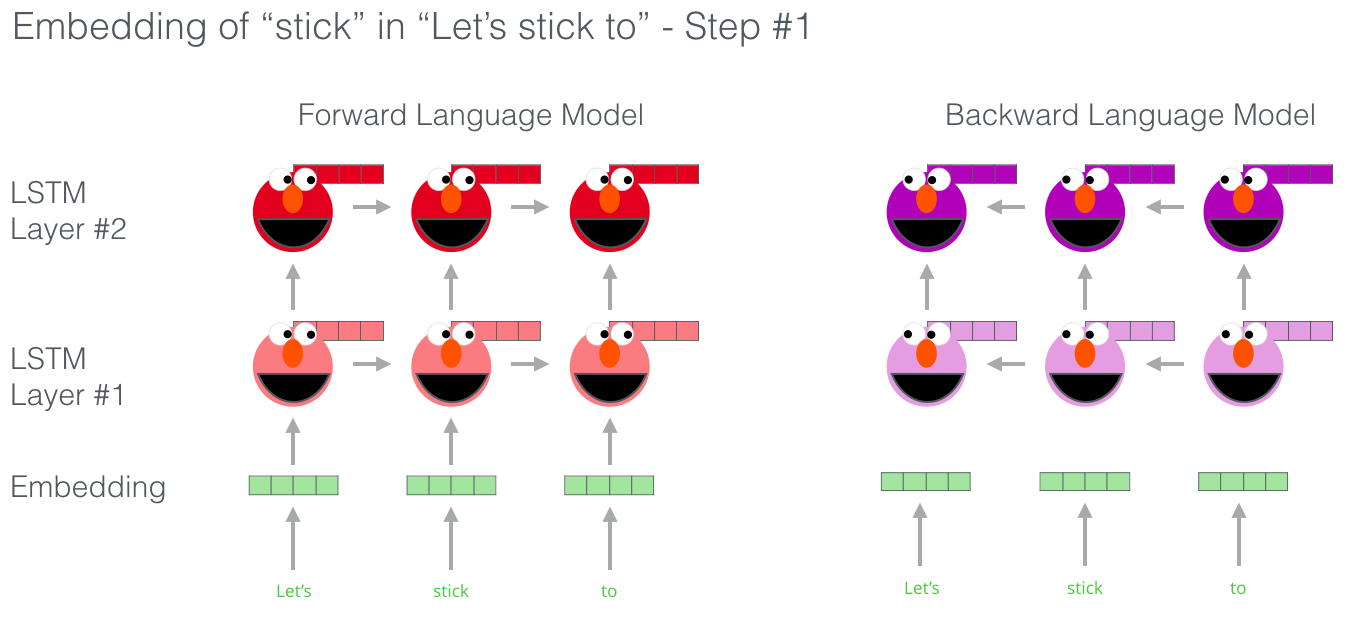

Matthew Peters on Twitter: "Our paper "Deep contextualized word representations" is now on Arxiv. ELMo representations from pre-trained language models set new SOTA for 6 diverse NLP tasks, SQuAD, SNLI, SRL, coref,

Training ELMO from Scratch on Custom Data-set for Generating Embeddings: Tensorflow | Machine Learning in Action